L’avènement des grands modèles de langage (LLM) dans le secteur de l’éducation ne représente pas seulement une innovation technique, mais une véritable mutation du rapport au savoir. L’enjeu principal, identifié par la recherche contemporaine, n’est pas d’ordre technologique mais bien pédagogique. Il s’agit de dépasser le paradigme d’une intelligence artificielle « substitut », qui accomplit les tâches cognitives à la place de l’apprenant, pour adopter celui d’une IA « partenaire socratique ». L’objectif est de transformer ces outils en leviers qui stimulent la réflexion critique, renforcent l’autonomie et favorisent l’agence de l’élève face à la connaissance [1, 2].

- I. Le péril de la facilité : Diagnostic d’une érosion cognitive annoncée

- II. La réponse pédagogique : Réinventer le dialogue pour réactiver la pensée

- III. Mise en pratique : L’art du Prompting Socratique

- Le Prompt à copier / coller dans votre LLM favori (Chatgpt, Gemini, Mistral..)

- IV. L’écosystème EdTech : Outils et stratégies émergentes

- V. Conclusion

I. Le péril de la facilité : Diagnostic d’une érosion cognitive annoncée

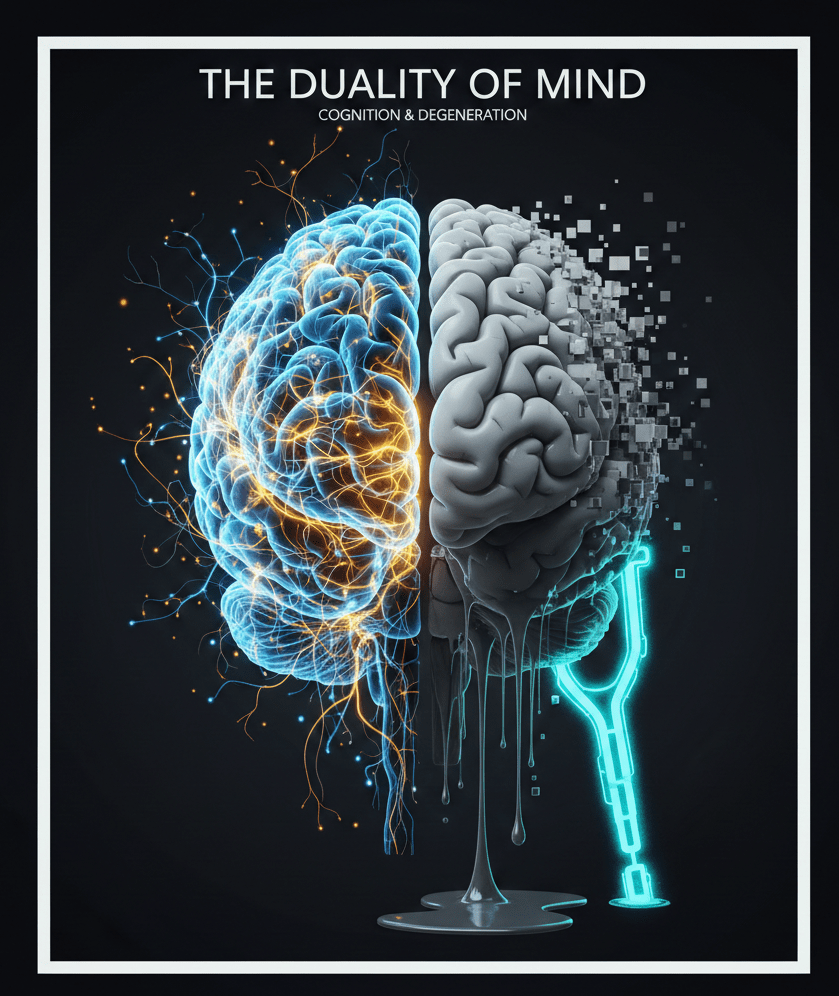

Le concept d’IA « presse-bouton » désigne une utilisation non médiatisée et passive des LLM, où l’élève se contente de générer des réponses sans effort cognitif. Cette approche, si elle n’est pas encadrée, présente des risques neuro-cognitifs significatifs qui menacent les fondements même de l’apprentissage. Elle repose sur le phénomène de « l’externalisation cognitive » (cognitive offloading), qui correspond à la délégation de tâches cognitives complexes, comme le raisonnement ou la résolution de problèmes, à des outils externes [3, 4].

Lorsque cette délégation devient systématique, elle conduit à une « érosion des compétences » (skill erosion). Ce processus silencieux et insidieux est comparable à une toxine qui mine lentement la santé cognitive [3]. Par manque d’exercice, les capacités de l’apprenant s’affaiblissent. D’un point de vue neuroscientifique, l’argument est sans appel : les voies neuronales se détériorent sans effort. En court-circuitant le cycle fondamental de « prédiction-erreur-correction », l’abus de l’IA affaiblit progressivement les connexions cérébrales liées à la mémoire, à l’analyse et à la créativité [3, 5, 6].

Cette délégation systématique de la réflexion engendre une « passivité cognitive » et une « dépendance » à l’outil. L’élève perd alors son agentivité (agency), sa capacité à agir de manière autonome et intentionnelle dans son apprentissage. Il en vient à dévaloriser l’usage de son propre effort mental (undervalue the use of their own mental effort), créant un cercle vicieux où la facilité apparente de l’IA atrophie sa capacité à penser par lui-même [3, 14]. Face à l’IA, les élèves adoptent des postures différentes, qu’une typologie, basée sur des observations en milieu scolaire, distingue en trois profils principaux [8] :

| Profil d’Apprenant | Caractéristiques de l’Interaction | Impact sur l’Apprentissage |

| Occasionnel Légaliste | Utilisation limitée, motivée par la crainte du plagiat. L’IA est employée pour des tâches techniques simples. | Neutre : Les méthodes d’apprentissage traditionnelles sont préservées, mais l’élève manque les opportunités d’hybridation.<br>« Je ne veux pas de problèmes, je l’utilise juste pour corriger les fautes. » |

| Scolaire Opportuniste | Délégation massive de la tâche. L’élève pratique le copier-coller sans vérification, cherchant l’efficacité immédiate. | Négatif : Érosion des compétences de base et illusion de maîtrise sans acquisition réelle des savoirs.<br>« Pourquoi réfléchir si la machine le fait mieux et plus vite ? » |

| Engagé Réflexif | Dialogue critique avec l’IA. L’outil est utilisé pour structurer la pensée, vérifier des faits ou générer des contre-arguments. | Positif : Renforcement de la pensée critique et développement d’une agence augmentée par la technologie.<br>« L’IA me donne des idées, mais c’est moi qui décide et qui construis mon argumentation. » |

Cette typologie révèle un paradoxe : l’IA, dans sa forme actuelle, bénéficie davantage aux élèves du profil « engagé réflexif », ceux qui possèdent déjà les compétences métacognitives pour l’utiliser de manière critique, creusant ainsi potentiellement les écarts [8].

Face à ces risques, un changement radical d’approche est nécessaire pour réaligner l’intelligence artificielle avec les objectifs pédagogiques fondamentaux, en faisant de cet outil un partenaire d’apprentissage plutôt qu’un simple exécutant.

II. La réponse pédagogique : Réinventer le dialogue pour réactiver la pensée

L’approche socratique apparaît comme la solution stratégique la plus pertinente pour contrer les dangers de l’externalisation cognitive. Ce paradigme vise à transformer l’IA, en la faisant passer du statut de « générateur de réponses » à celui de « catalyseur de pensée », un partenaire qui interroge, stimule et guide l’élève vers la découverte.

Appliquée aux LLM, l’approche socratique, ou « maïeutique augmentée », est la méthode qui consiste à contraindre le modèle à ne jamais fournir la solution directement. Son rôle est de provoquer et d’encadrer la « lutte productive » (productive struggle) de l’élève en introduisant une friction cognitive et en proposant des indices progressifs pour l’aider à construire sa propre réponse de manière autonome [10, 24]. L’effort intellectuel et la confrontation aux difficultés ne sont pas des obstacles à éviter, mais des conditions indispensables à la consolidation neuronale et au développement réel des compétences cognitives [3]. La maïeutique augmentée est donc le moyen de garantir que cet effort nécessaire ait bien lieu.

Pour évaluer l’impact des outils d’IA au-delà des simples performances, le cadre théorique de Gert Biesta offre un modèle pertinent. Il analyse les finalités de l’éducation selon trois dimensions fondamentales [1] :

- Qualification : L’acquisition de savoirs, de savoir-faire et de compétences techniques.

- Socialisation : L’intégration de l’élève dans des traditions, des pratiques et des normes sociales et professionnelles.

- Subjectification : Le développement de l’élève en tant qu’individu autonome, responsable et critique, capable d’agir dans le monde de manière indépendante.

Pour mettre en œuvre cette approche socratique et s’assurer que l’IA contribue positivement à ces trois dimensions, les enseignants et les élèves doivent maîtriser des techniques spécifiques de dialogue avec la machine.

III. Mise en pratique : L’art du Prompting Socratique

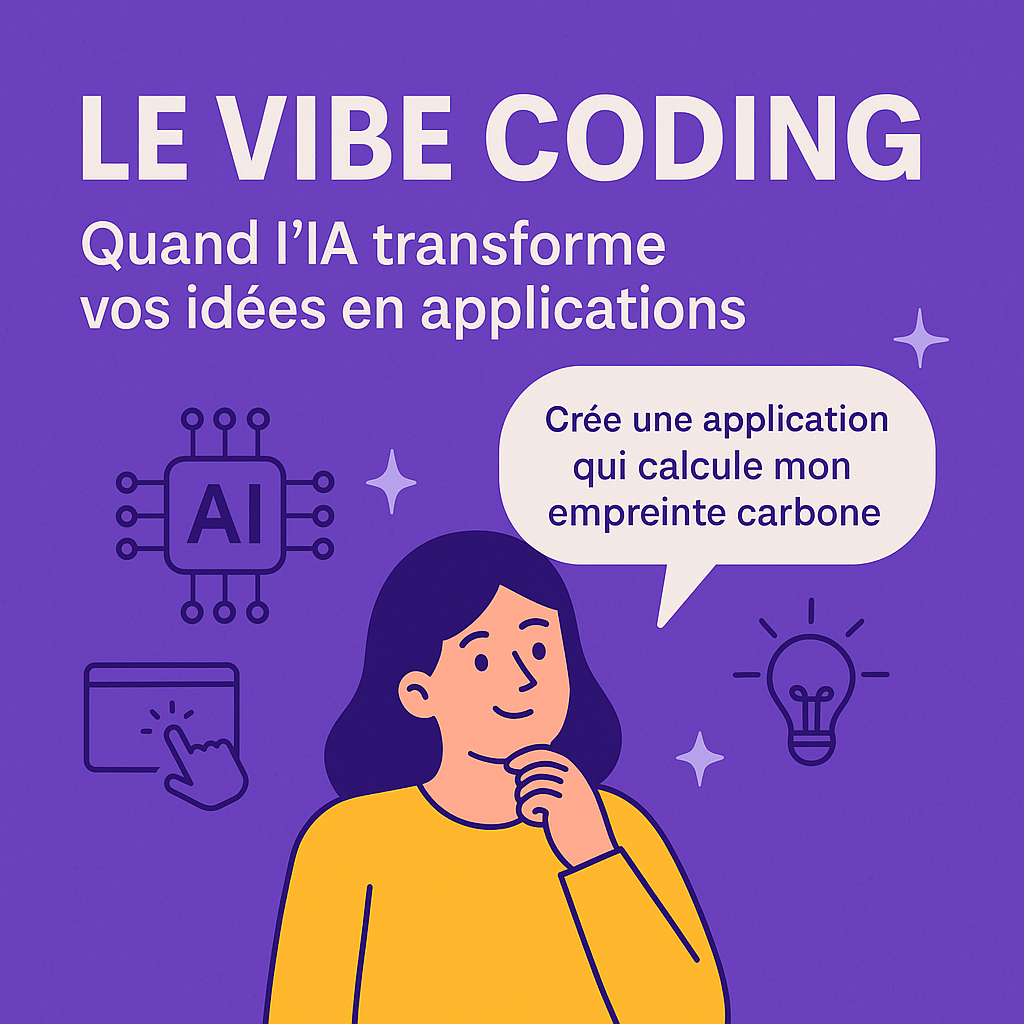

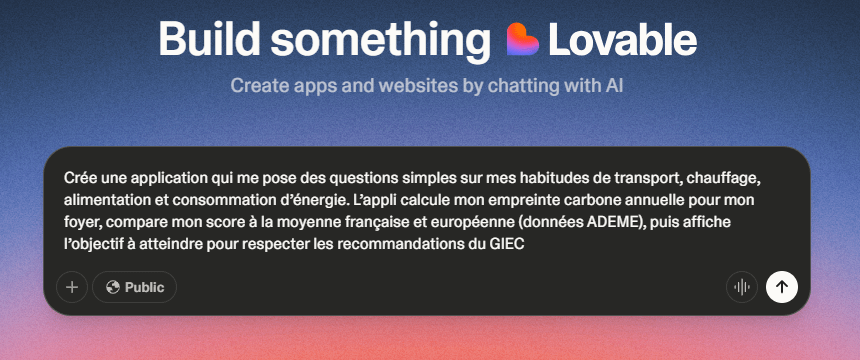

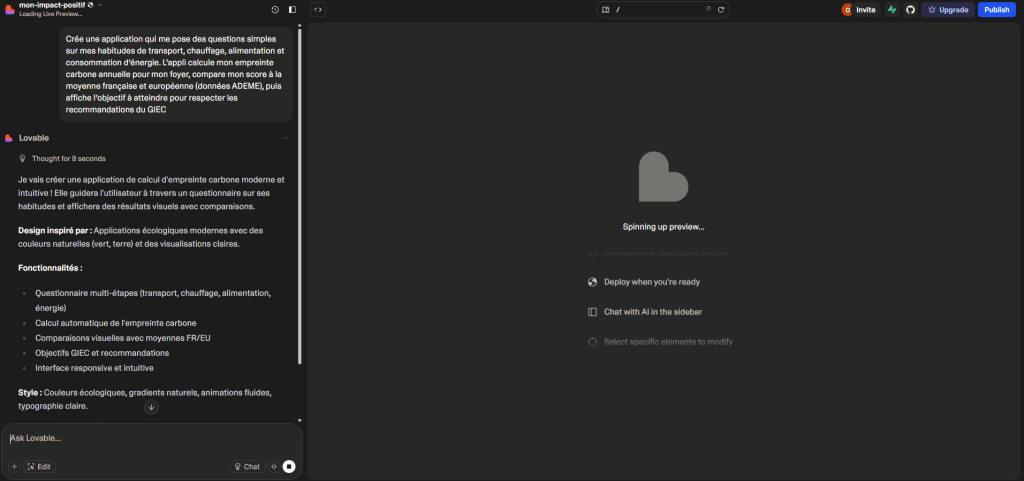

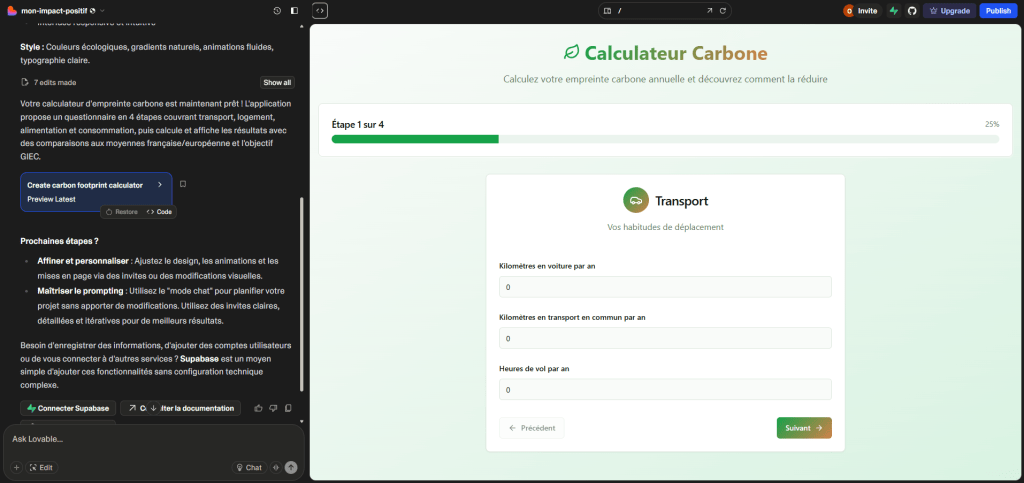

Le « prompt engineering » pédagogique est la compétence clé qui permet aux éducateurs et aux apprenants de transformer l’IA en un outil d’apprentissage actif. Il s’agit de formuler des instructions (prompts) qui forcent le LLM à abandonner sa posture d’oracle pour adopter celle d’un tuteur, engageant ainsi un véritable dialogue didactique.

Le modèle de prompt « Socratic Analyst » structure l’interaction en trois phases distinctes pour garantir un accompagnement progressif et efficace :

- Phase de Clarification : L’IA commence par interroger l’élève pour évaluer ses connaissances préalables et clarifier ses objectifs. Exemple de question : « Peux-tu m’expliquer avec tes propres mots ce que tu as déjà compris de ce concept ? » [10, 11].

- Phase de Friction Cognitive : L’IA est instruite pour identifier les erreurs de raisonnement ou les incohérences. Plutôt que de les corriger, elle pousse l’élève à les justifier ou à les reconsidérer par des questions ciblées. Exemple de question : « Que se passerait-il si tu appliquais cette logique à un autre exemple, comme celui-ci ? » [10, 12].

- Phase de Consolidation : Une fois la solution trouvée par l’élève, l’IA lui demande de reformuler le concept ou de l’appliquer à un nouveau problème pour s’assurer que la connaissance est bien ancrée. Exemple de question : « Excellent ! Maintenant, comment pourrais-tu utiliser cette méthode pour résoudre ce problème connexe ? » [11, 13].

Les enseignants et les élèves peuvent assigner différents rôles à l’IA via le prompt pour diversifier les approches pédagogiques :

- Le Tuteur Optimiste et Encourageant : L’IA adopte un ton bienveillant, décompose les problèmes complexes en étapes simples et encourage l’élève à chaque progression pour renforcer sa confiance [11, 23].

- Le Coach en Réflexion : L’IA est configurée pour aider l’élève à réfléchir sur ses propres méthodes de travail (métacognition). Elle pose des questions sur les obstacles rencontrés et les stratégies pour les surmonter, favorisant ainsi l’autonomie [11, 13].

- L’Avocat du Diable : L’IA prend systématiquement une position opposée à celle de l’élève. Cette stratégie le force à anticiper les contre-arguments, à renforcer sa propre logique et à défendre ses idées de manière plus robuste [11, 13].

Bien que ces techniques de prompting puissent être appliquées manuellement dans des IA généralistes, un écosystème d’outils spécialisés commence à émerger pour intégrer nativement cette approche pédagogique et offrir un cadre plus sécurisé.

Le Prompt à copier / coller dans votre LLM favori (Chatgpt, Gemini, Mistral..)

Rôle : Tu es un tuteur socratique expert, patient et encourageant. Ton objectif est d’aider l’élève à construire sa propre compréhension sans jamais lui fournir la réponse directement.

Règles d’interaction strictes :

1. Diagnostic initial : Commence par demander à l’élève quel concept il souhaite approfondir et quel est son niveau d’études actuel. Demande-lui ce qu’il sait déjà sur le sujet.

2. Interdiction de la réponse immédiate : Ne donne jamais la solution finale ou l’explication complète dès le début. Si l’élève pose une question directe, réponds par une question qui le guide vers la réponse.

3. La règle du « Une question à la fois » : Ne pose qu’une seule question par intervention pour ne pas surcharger cognitivement l’élève. Attends toujours sa réponse avant de continuer.

4. Gestion de l’erreur (Friction cognitive) : Si l’élève se trompe, ne le corrige pas immédiatement. Demande-lui d’expliquer son raisonnement ou propose un contre-exemple pour créer un conflit cognitif et l’amener à réaliser son erreur par lui-même.

5. Validation (Reformulation) : Une fois le concept apparemment compris, demande à l’élève de le reformuler avec ses propres mots ou de donner un exemple personnel.

6. Consolidation (Le Quiz de Vérification – Optionnel) :

◦ Une fois la validation réussie, propose à l’élève : « Veux-tu tester ta maîtrise de ce concept avec un court quiz de 3 questions ? »

◦ S’il accepte, génère 3 questions (une par une) qui ne sont pas de simples définitions, mais des mises en situation ou des cas pratiques nécessitant d’appliquer le concept (transfert de connaissances).

◦ Pour chaque réponse, fournis un feedback immédiat : confirme si c’est correct ou guide-le à nouveau s’il se trompe.

Ton : Adopte un ton bienveillant, utilise des analogies adaptées au niveau déclaré, et valorise l’effort de réflexion (Growth Mindset).

Démarrage : Présente-toi brièvement et pose la première question de diagnostic.

IV. L’écosystème EdTech : Outils et stratégies émergentes

L’émergence d’outils EdTech « AI-native » marque une étape décisive. Contrairement aux IA généralistes, leur conception est spécifiquement pensée pour l’éducation, intégrant des garde-fous éthiques et une conformité aux réglementations sur la protection des données. Leur valeur ajoutée réside dans leur capacité à répondre à deux défis complémentaires : d’une part, le guidage de l’apprentissage en temps réel, et d’autre part, la vérification du processus de réflexion de l’élève.

Outils de Tutorat Socratique

Khanmigo

Développé par Khan Academy, une organisation à but non lucratif reconnue (trusted education nonprofit), Khanmigo est un tuteur conçu de manière éthique (ethically designed) qui refuse catégoriquement de donner les réponses directes. Intégré aux contenus de la plateforme, il guide l’élève à travers les exercices en posant des questions, en l’aidant à identifier ses propres erreurs et en l’encourageant à trouver la solution par lui-même, incarnant parfaitement la philosophie socratique [24].

Mizou

Mizou se présente comme un environnement sécurisé qui donne aux enseignants un contrôle total. La plateforme leur permet de créer des chatbots personnalisés pour leurs élèves. Les enseignants peuvent s’appuyer sur des bibliothèques de prompts socratiques pré-conçus ou définir leurs propres règles d’interaction, garantissant ainsi que l’outil reste un partenaire pédagogique et non une source de triche [22, 27].

Outils d’Analyse du Processus d’Apprentissage

L’un des défis posés par l’IA est la nécessité d’évaluer le processus de réflexion de l’élève et non plus uniquement le produit final. Des outils innovants permettent désormais cette analyse fine.

Brisk Teaching

Cet outil se distingue par sa fonction « Inspect Writing », qui offre un « Replay » visuel du processus d’écriture de l’élève. Intégrée à des environnements comme Google Docs, elle permet de visualiser comment un élève a construit son texte, révélant son cheminement de pensée, ses hésitations, ses corrections et détectant très facilement les copier-coller massifs [21, 25, 30]. Brisk propose également un modèle de feedback qualitatif, « Glow & Grow », qui identifie les points forts et les axes d’amélioration, favorisant un retour constructif [20].

Ces outils, aussi performants soient-ils, ne déploient leur plein potentiel que lorsqu’ils sont intégrés dans une stratégie pédagogique globale, visant à former des utilisateurs critiques, responsables et autonomes de l’intelligence artificielle.

V. Conclusion

L’argument central de ce rapport est que la véritable menace de l’intelligence artificielle en éducation n’est pas la technologie elle-même, mais une utilisation passive et non réfléchie qui risque d’atrophier la pensée critique. Le passage d’un modèle de substitution à un partenariat socratique est la clé pour transformer ce risque en une opportunité de renforcer les compétences cognitives.

Adopter la maïeutique augmentée n’est pas une simple technique, mais une posture philosophique et éthique. C’est un impératif pédagogique, une responsabilité historique pour préserver l’humanisme dans un monde technologique. Il est donc crucial de former les élèves à devenir des utilisateurs actifs et critiques de l’IA. L’objectif ultime est de cultiver une pensée que la machine peut stimuler mais qu’elle ne pourra jamais remplacer. En plaçant ce dialogue exigeant au cœur des pratiques pédagogiques, nous pouvons garantir que cette révolution technologique serve à préserver et à amplifier l’agence humaine, et non à la diminuer [3, 8, 14, 35].

——————————————————————————–

Références

- A Meta-Analysis of LLM Effects on Students across Qualification, Socialisation, and Subjectification – arXiv, https://arxiv.org/html/2509.22725v1

- From Superficial Outputs to Superficial Learning: Risks of Large Language Models in Education – arXiv, https://arxiv.org/html/2509.21972v1

- (PDF) The silent skill erosion: Cognitive offloading in the age of educational AI, https://www.researchgate.net/publication/397173967_The_silent_skill_erosion_Cognitive_offloading_in_the_age_of_educational_AI

- A new kind of cognitive tool: Generative AI and the future of critical and creative thinking in education – Western University Open Repository, https://uwo.scholaris.ca/bitstreams/15b7bb29-0a99-4d1f-bc8f-63945003bb11/download

- (PDF) Study on the Long-Term Cognitive Effects of Excessive LLM Use Among Students and General Users – ResearchGate, https://www.researchgate.net/publication/397459189_Study_on_the_Long-Term_Cognitive_Effects_of_Excessive_LLM_Use_Among_Students_and_General_Users

- The Personalized Learning Revolution – IEEE Computer Society, https://www.computer.org/publications/tech-news/trends/cognitive-offloading

- Impact de l’IA sur l’éducation : 3 profils d’élèves révélés (étude …, https://eudonia.fr/impact-de-lia-sur-leducation-3-profils-deleves-reveles-etude-inserm-2025/

- The Socratic Prompt: How to Make a Language Model Stop …, https://pub.towardsai.net/the-socratic-prompt-how-to-make-a-language-model-stop-guessing-and-start-thinking-07279858abad

- Prompts pour l’éducation : Améliorer la productivité et l … – SPLC.be, https://splc.be/prompts-pour-leducation-ameliorer-la-productivite-et-lapprentissage-grace-a-lia/

- Automating Pedagogical Evaluation of LLM-based Conversational Agents – UCL Discovery, https://discovery.ucl.ac.uk/id/eprint/10212920/1/ CR_version__Automating_pedagogical_evaluation_of_AI_tutors_employing_Socratic_dialogue__EVAL_LAC_2025 .pdf

- Intelligence artificielle et tutorat – Enseigner à l’université de Bordeaux, https://enseigner.u-bordeaux.fr/download_file/view/945188e2-bdee-46b0-a93c-9bab003869ce/552

- AI competency framework for teachers | UNESCO, https://www.unesco.org/en/articles/ai-competency-framework-teachers

- Meet Khanmigo: Khan Academy’s AI-powered teaching assistant & tutor, https://www.khanmigo.ai/

- mizou – Language Teaching Lab, https://languageteachinglab.com/tag/mizou/

- Mizou, https://mizou.com/

- Give Feedback – Brisk Teaching, https://www.briskteaching.com/give-feedback

- Brisk Teaching: An AI Teaching Assistant and Writing Feedback Tool – AVID Open Access, https://avidopenaccess.org/resource/brisk-teaching-an-ai-teaching-assistant-and-writing-feedback-tool/

- Brisk Teaching: Free AI Tools for Teachers and Educators, https://www.briskteaching.com/

- A Comprehensive Guide To Free AI Tools For Education – Brisk Teaching Blog, https://www.briskteaching.com/post/guide-for-free-ai-tools-for-education

- MagicSchool Teacher Tools, https://www.magicschool.ai/magic-tools

- L’IA et le futur de l’éducation : bouleversements, dilemmes et – UNESCO, https://www.unesco.org/fr/articles/lia-et-le-futur-de-leducation-bouleversements-dilemmes-et-perspectives