Ce guide s’adresse aux dirigeants de PME et DSI qui souhaitent exploiter la puissance de l’IA générative tout en garantissant une confidentialité totale de leurs données. Il fournit une feuille de route claire pour choisir et déployer une solution d’IA locale, en arbitrant de manière éclairée entre les options techniques, les contraintes budgétaires et les impératifs de conformité.

- 1. Introduction : Le Dilemme Productivité vs. Confidentialité

- 2. Solution 1 : L’Approche « Poste par Poste » – L’IA Individuelle et Autonome

- 3. Solution 2 : L’Approche « Serveur Centralisé » – L’IA Collaborative d’Entreprise

- 4. Analyse Comparative : Avantages, Inconvénients et Limites des Solutions Locales

- 5. Alternative Stratégique : Comparaison avec un Abonnement « Entreprise » SaaS Souverain

- 6. Conclusion : Une IA Souveraine à la Portée de Chaque PME

- 7. Sources

1. Introduction : Le Dilemme Productivité vs. Confidentialité

Pour les dirigeants de petites et moyennes entreprises (PME), l’intelligence artificielle (IA) générative représente à la fois une opportunité historique et un défi stratégique majeur. Le dilemme est clair : comment exploiter l’immense potentiel de productivité de ces technologies sans compromettre la confidentialité des données d’entreprise et la conformité au Règlement Général sur la Protection des Données (RGPD) ? La promesse d’automatiser les tâches chronophages et d’accélérer l’innovation est puissante, mais la perspective de voir des informations sensibles transiter par des serveurs tiers est un frein légitime à l’adoption [2, 8].

Les gains de productivité permis par l’IA sont concrets et mesurables. Des tâches administratives comme le tri d’emails, la rédaction de comptes-rendus ou la synthèse de documents longs peuvent être massivement accélérées [2, 3]. Dans les ressources humaines, l’IA peut analyser des centaines de CV pour identifier les profils les plus pertinents, tandis qu’en marketing, elle peut générer du contenu pour les réseaux sociaux en quelques secondes [3]. Les chiffres confirment cette perception : 87 % des dirigeants estiment que l’IA fait gagner les salariés en rapidité, et 63 % qu’elle réduit les tâches fastidieuses, améliorant ainsi les conditions de travail [3].

Cependant, l’utilisation d’outils cloud grand public comme ChatGPT ou Claude soulève un risque critique. L’envoi de données sensibles – qu’il s’agisse de contrats, de données clients, de bilans financiers ou de code source propriétaire – vers les serveurs d’une entreprise tierce constitue une rupture de la chaîne de confiance [2]. Cette pratique expose non seulement les secrets de l’entreprise, mais crée également un risque de non-conformité avec le RGPD, qui encadre strictement le traitement et le transfert des données personnelles [7, 9].

Face à ce défi, le déploiement local de modèles de langage (LLM) apparaît comme une solution libératrice. En choisissant d’auto-héberger l’IA sur sa propre infrastructure, une PME construit son propre « bastion numérique souverain » [2]. Cette approche garantit une confidentialité absolue, une maîtrise totale de l’information et une indépendance vis-à-vis des géants de la tech. Les données ne quittent jamais les murs de l’entreprise, transformant l’IA d’un risque potentiel en un avantage compétitif sécurisé [4].

Cet article explore les deux principales stratégies pour mettre en œuvre une IA locale, depuis l’équipement individuel jusqu’à la plateforme collaborative d’entreprise.

2. Solution 1 : L’Approche « Poste par Poste » – L’IA Individuelle et Autonome

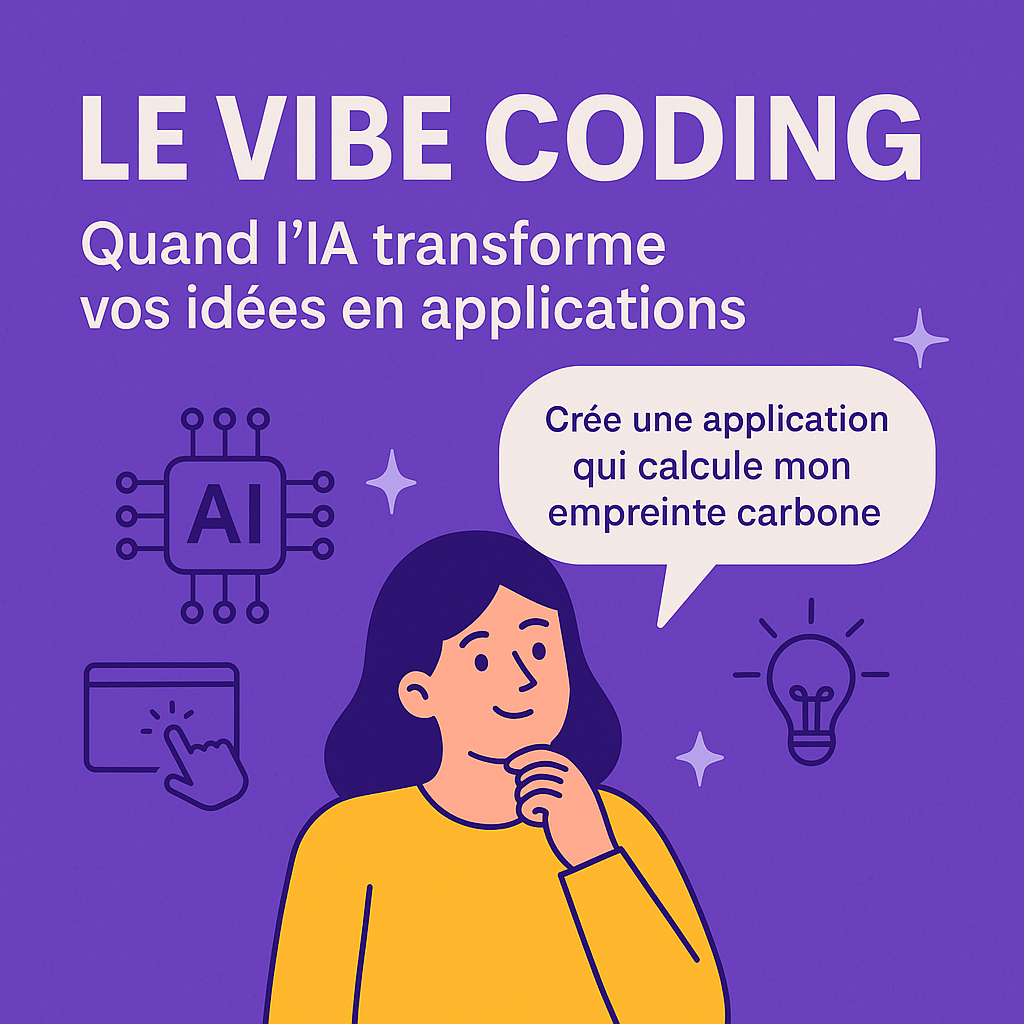

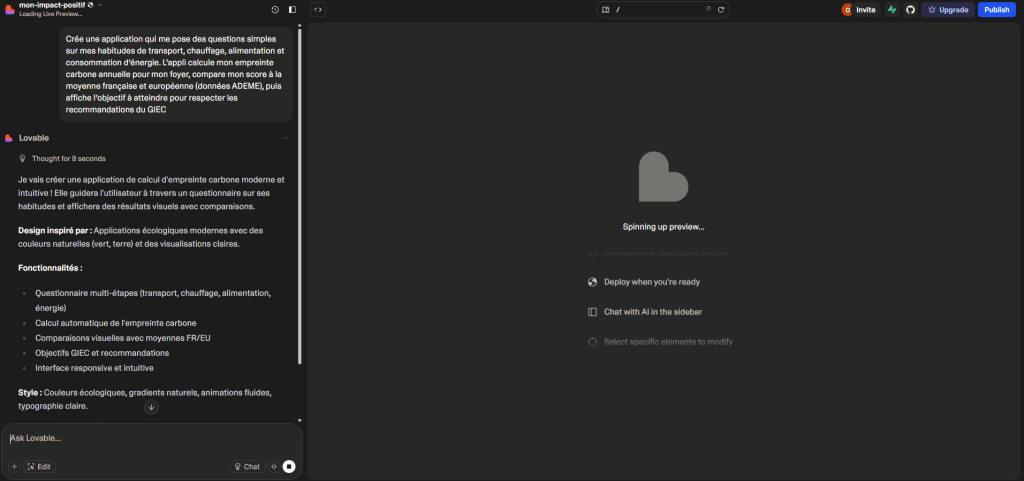

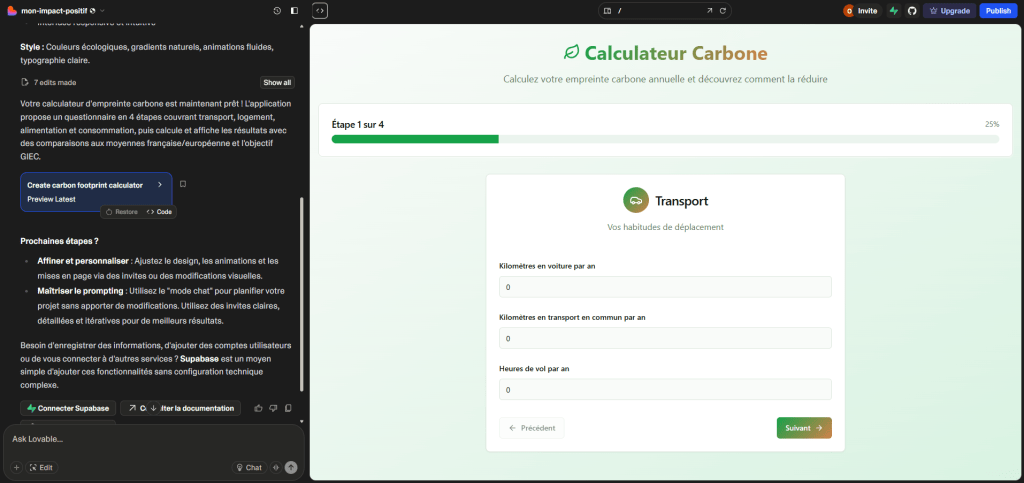

L’approche « poste par poste » constitue la porte d’entrée la plus accessible et la moins coûteuse pour les PME souhaitant expérimenter la puissance de l’IA locale. Cette stratégie consiste à équiper des collaborateurs clés avec des outils personnels et sécurisés, leur permettant de bénéficier de l’IA sans impacter l’ensemble de l’infrastructure informatique de l’entreprise.

Le standard technique pour exécuter des modèles de langage open source (comme Llama 3 de Meta ou Mistral 7B) est Ollama. Cet outil, simple à installer, fonctionne en arrière-plan et expose une API locale. Pour les utilisateurs techniques, il s’utilise directement via le terminal, mais sa véritable force est de pouvoir se connecter à une multitude d’interfaces graphiques conviviales [2, 4].

Pour les utilisateurs non-techniques, plusieurs interfaces graphiques permettent une expérience intuitive et sans code :

- LM Studio : C’est la solution « point-and-click » idéale pour les débutants. Son interface permet de chercher, télécharger et exécuter des modèles en quelques clics, offrant une expérience très similaire à celle de ChatGPT, sans nécessiter la moindre ligne de code [2, 4].

- Jan : Il s’agit d’une alternative open source qui met un accent particulier sur la confidentialité. Conçu pour fonctionner à 100 % hors-ligne, Jan garantit qu’aucune donnée, même pas de télémétrie, ne quitte le poste de travail de l’utilisateur [4].

L’analyse des prérequis matériels pour cette approche révèle un facteur de performance crucial : la VRAM, ou mémoire vidéo de la carte graphique (GPU) [2, 6]. C’est elle qui détermine la taille et la complexité des modèles que vous pouvez exécuter. Un ordinateur de bureau standard sans GPU dédié sera lent et peu efficace. Le « sweet spot » pour une PME se situe souvent du côté des Mac récents équipés de puces Apple Silicon (M1/M2/M3/M4). Grâce à leur architecture de mémoire unifiée, qui permet au processeur (CPU) et au processeur graphique (GPU) de partager le même pool de mémoire à haute vitesse, ils éliminent le goulot d’étranglement lié au transfert de données entre la RAM système et la VRAM dédiée que l’on trouve dans les PC traditionnels. Cette particularité améliore drastiquement les performances pour les LLM tout en offrant un rapport performance/consommation électrique exceptionnel pour cette tâche [4].

Si cette approche est parfaite pour démarrer et équiper des individus, elle montre ses limites dès que le besoin de collaboration et de partage de connaissances se fait sentir. L’étape suivante est alors de centraliser la ressource pour en faire un véritable outil d’entreprise.

3. Solution 2 : L’Approche « Serveur Centralisé » – L’IA Collaborative d’Entreprise

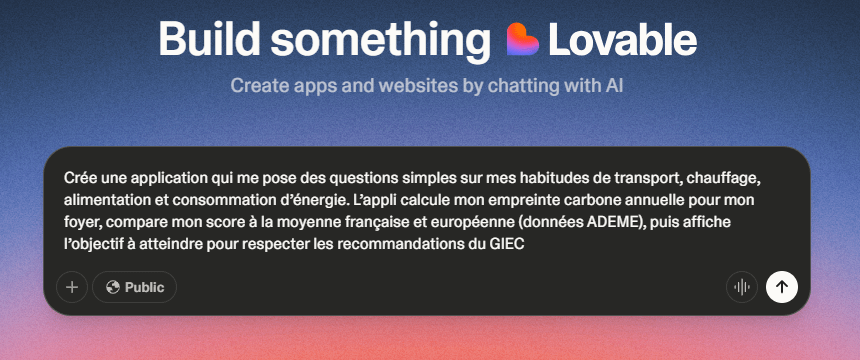

Pour une PME qui souhaite faire de l’IA une ressource stratégique, l’architecture client-serveur représente l’étape de maturité suivante. Cette approche transforme l’IA d’un outil personnel en une plateforme collaborative, centralisée et facile à administrer pour l’ensemble des collaborateurs. L’idée est simple : un serveur puissant héberge le modèle de langage, et les employés y accèdent via une interface web depuis leur navigateur.

Deux solutions se distinguent particulièrement pour mettre en place une telle architecture :

AnythingLLM : La Plateforme Orientée « Business »

AnythingLLM est spécifiquement conçu pour les cas d’usage en entreprise. Ses fonctionnalités clés incluent :

- La gestion multi-utilisateurs : Créez des comptes pour chaque collaborateur.

- Les espaces de travail isolés : Séparez les connaissances par département (un espace pour les RH, un pour le Marketing, un pour la Direction) pour garantir que les informations restent cloisonnées.

- Le RAG (Retrieval-Augmented Generation) intégré : Permet de « discuter » avec les documents de l’entreprise. Les employés peuvent poser des questions en langage naturel sur des PDF, des rapports ou des contrats, et l’IA répond en se basant uniquement sur ces sources internes.

- Installation facile : Disponible en version Desktop pour des tests rapides ou via Docker pour un déploiement serveur robuste [8].

Open WebUI : L’Expérience « ChatGPT Interne »

Anciennement connu sous le nom d’Ollama WebUI, Open WebUI vise à recréer l’expérience utilisateur de ChatGPT, mais de manière totalement privée. Son interface est si intuitive que les employés n’ont besoin d’aucune formation pour l’adopter. Sa connexion native avec le moteur Ollama en fait un choix naturel et performant pour une infrastructure centralisée, garantissant une intégration technique fluide et stable [1, 8].

La gestion des accès est un point fondamental dans un contexte d’entreprise. AnythingLLM est particulièrement avancé sur ce point, proposant nativement une gestion fine des rôles et des permissions, ce qui répond aux besoins de sécurité des entreprises [8]. Open WebUI propose également une gestion multi-utilisateurs avec authentification, assurant que seuls les collaborateurs autorisés peuvent accéder à la plateforme [8].

Pour supporter les requêtes de plusieurs utilisateurs simultanément, l’infrastructure serveur doit être à la hauteur. L’exigence fondamentale reste la même que pour une approche poste par poste : la VRAM est le facteur limitant. Cependant, dans une architecture centralisée, la VRAM doit être suffisante pour gérer non pas une, mais plusieurs requêtes simultanées, ce qui justifie l’investissement dans des GPU professionnels NVIDIA RTX dotés de grandes capacités mémoire. Il est donc nécessaire de s’équiper de serveurs dédiés ou de stations de travail puissantes, comme les modèles Dell Precision, équipés de ces cartes graphiques qui fournissent la puissance de calcul nécessaire pour une expérience fluide à l’échelle de l’entreprise [6].

Bien que puissantes, ces solutions locales présentent des avantages et des inconvénients qu’il convient d’analyser en détail pour faire un choix éclairé.

4. Analyse Comparative : Avantages, Inconvénients et Limites des Solutions Locales

Cette section a pour objectif de fournir aux décideurs une grille d’analyse claire et objective pour évaluer la pertinence de l’auto-hébergement par rapport à leurs contraintes budgétaires, techniques et opérationnelles. Le choix d’une IA locale est avant tout un arbitrage stratégique.

Avantages Clés de l’Auto-Hébergement

- Confidentialité Absolue : Les données sensibles (financières, clients, R&D) ne quittent jamais l’infrastructure de l’entreprise, éliminant tout risque de fuite ou d’exploitation par des tiers [2, 4].

- Coût Maîtrisé : Après l’investissement initial, il n’y a plus de frais récurrents par utilisateur ou par requête (token). Le coût devient prévisible, contrairement aux abonnements SaaS (OpEx) qui peuvent rapidement grimper [4].

- Disponibilité Totale : Le service est accessible en continu, même en cas de coupure de la connexion Internet, garantissant une productivité sans interruption [4].

- Conformité RGPD Simplifiée : En l’absence de transfert de données en dehors de l’Union Européenne, la mise en conformité réglementaire est drastiquement simplifiée [4, 8].

Inconvénients et Contraintes à Anticiper

- Investissement Matériel Initial : L’achat de serveurs ou de postes de travail dotés de GPU puissants représente un coût initial (CapEx) non négligeable [5, 6].

- Maintenance Interne : L’entreprise est entièrement responsable de la maintenance des logiciels, de la sécurité du serveur et des mises à jour des modèles d’IA, ce qui requiert des compétences techniques [5].

- Performance Liée au Matériel : La vitesse de réponse et la capacité de l’IA (complexité des modèles supportés) sont directement plafonnées par la puissance du matériel acquis [2, 6].

Au-delà de ces points, il est crucial de comprendre les limites techniques inhérentes à une approche locale :

- La « fenêtre de contexte » est limitée : La quantité d’information que le modèle peut analyser en une seule fois (par exemple, la longueur d’un document) est physiquement limitée par la VRAM du GPU. Des documents très volumineux peuvent nécessiter des stratégies de découpage [2].

- La vitesse de génération peut être inférieure : La vitesse de génération de texte (mesurée en tokens par seconde) sur du matériel de PME sera souvent inférieure à celle des services cloud, qui reposent sur des fermes de serveurs massivement parallèles [6].

- Le « fine-tuning » reste complexe : La spécialisation d’un modèle sur les données spécifiques de l’entreprise (fine-tuning) est une opération qui reste complexe et gourmande en ressources, nécessitant une expertise dédiée [6].

Pour les entreprises qui jugent l’investissement ou la maintenance locale trop lourds, une troisième voie existe : le SaaS souverain.

5. Alternative Stratégique : Comparaison avec un Abonnement « Entreprise » SaaS Souverain

Pour les PME qui recherchent un équilibre entre la facilité d’utilisation du cloud et les exigences de souveraineté des données, les offres SaaS « souveraines » représentent une alternative stratégique viable. Des acteurs comme l’entreprise française Mistral AI proposent des abonnements professionnels où les modèles sont hébergés sur des infrastructures cloud situées en Europe, offrant ainsi de solides garanties en matière de conformité RGPD [5].

Voici une comparaison point par point pour éclairer la décision :

- Coût :

- Auto-hébergement : Repose sur un investissement initial en matériel (CapEx), avec des coûts de fonctionnement faibles (électricité, maintenance) [4].

- SaaS Souverain : Implique un coût d’abonnement récurrent par utilisateur ou par usage (OpEx), sans investissement initial.

- Facilité de Déploiement :

- Auto-hébergement : Nécessite des compétences techniques internes pour l’installation, la configuration et la maintenance continue du serveur et des logiciels [5].

- SaaS Souverain : Offre une approche « zéro maintenance ». Le fournisseur s’occupe de toute l’infrastructure, des mises à jour et de la sécurité. L’accès est instantané via une API ou une interface web.

- Performance et Accès aux Modèles :

- Auto-hébergement : L’accès aux modèles est limité par la puissance du matériel. On utilise souvent des modèles plus petits ou des versions « quantifiées » (compressées) pour garantir une bonne réactivité [2].

- SaaS Souverain : Donne accès aux modèles les plus puissants et les plus récents du fournisseur (par exemple, Mistral Large) sans aucune contrainte matérielle pour l’entreprise [5].

- Souveraineté et Sécurité :

- Auto-hébergement : Représente le niveau de contrôle et de sécurité maximal. Les données ne quittent physiquement jamais l’entreprise [2, 4].

- SaaS Souverain : Constitue un compromis pragmatique. Bien que les données soient confiées à un tiers, le fait qu’il s’agisse d’un acteur européen hébergeant les données en Europe offre un cadre juridique clair et une conformité RGPD robuste, bien supérieure à celle des acteurs non-européens [5].

Le choix s’articule donc autour d’un arbitrage entre le contrôle (maximal en local), le coût (CapEx pour le local, OpEx pour le SaaS) et la compétence technique (interne pour le local, externalisée pour le SaaS). Une PME sans DSI dédié mais avec des exigences RGPD strictes trouvera dans le SaaS souverain un compromis pragmatique, tandis qu’une entreprise technologique soucieuse de son IP optera pour le contrôle absolu de l’auto-hébergement.

6. Conclusion : Une IA Souveraine à la Portée de Chaque PME

L’idée d’une intelligence artificielle fonctionnant exclusivement au sein de l’entreprise, à l’abri des regards extérieurs, n’est plus un projet complexe réservé aux grands groupes. Grâce à la maturité de l’écosystème open source, l’IA locale est devenue une réalité accessible, économiquement viable et stratégiquement indispensable pour les PME soucieuses de leur souveraineté numérique.

La recommandation stratégique pour un déploiement réussi est d’adopter une approche progressive. Commencez par une phase de test sur un ou plusieurs postes de travail (Solution 1). Cette étape permet d’évaluer les cas d’usage les plus pertinents pour votre activité, de mesurer l’adoption par les équipes et de démontrer rapidement la valeur de l’IA sans investissement lourd. Une fois les bénéfices validés, la transition vers une infrastructure centralisée (Solution 2) devient une évolution naturelle pour transformer l’IA en un service partagé à l’échelle de l’entreprise.

Des outils comme Ollama ont démocratisé l’exécution des modèles, tandis que des plateformes comme AnythingLLM ou Open WebUI ont rendu leur utilisation aussi simple que celle de ChatGPT. Ces solutions sont les catalyseurs qui permettent aujourd’hui à chaque PME de construire son propre bastion de productivité, en conciliant innovation et confidentialité.

7. Sources

- GitHub: « A Step-by-Step guide, to configure ollama with open-webui »

- Tapis-Souris.fr: « Comment faire tourner une IA (LLM) en local pour ne pas envoyer vos données privées à OpenAI »

- FranceNum.gouv.fr: « Exploiter l’intelligence artificielle pour améliorer le fonctionnement de sa TPE PME : mode d’emploi »

- Glukhov.org: « Hébergement local de LLM : Guide complet 2026 – Ollama, vLLM … »

- LBKE.fr: « Héberger une IA générative en entreprise : le guide complet »

- Dell.com: « LLM : quelle station de travail pour un usage local ? »

- Entreprendre.service-public.fr: « Obligations en matière de protection des données personnelles (RGPD) »

- WZ-IT.com: « Open WebUI vs. AnythingLLM: The detailed comparison for self… »

- FranceNum.gouv.fr: « Protection des données personnelles : bilan de l’adoption du RGPD par les TPE PME »